Ramy artykułu:

- Tekst Ronana Farrowa i Andrew Marantza opiera się na ponad 100 rozmowach z ludźmi z różnych etapów kariery Sama Altmana (Loopt, Y Combinator, OpenAI, partnerzy zewnętrzni).

- Autorzy wykorzystują niepublikowane wcześniej dokumenty: ok. 70 stron „memów Ilyi” (wewnętrzne notatki Ilyi Sutskewera) oraz ponad 200 stron prywatnych notatek Daria Amodeia „My Experience with OpenAI”.

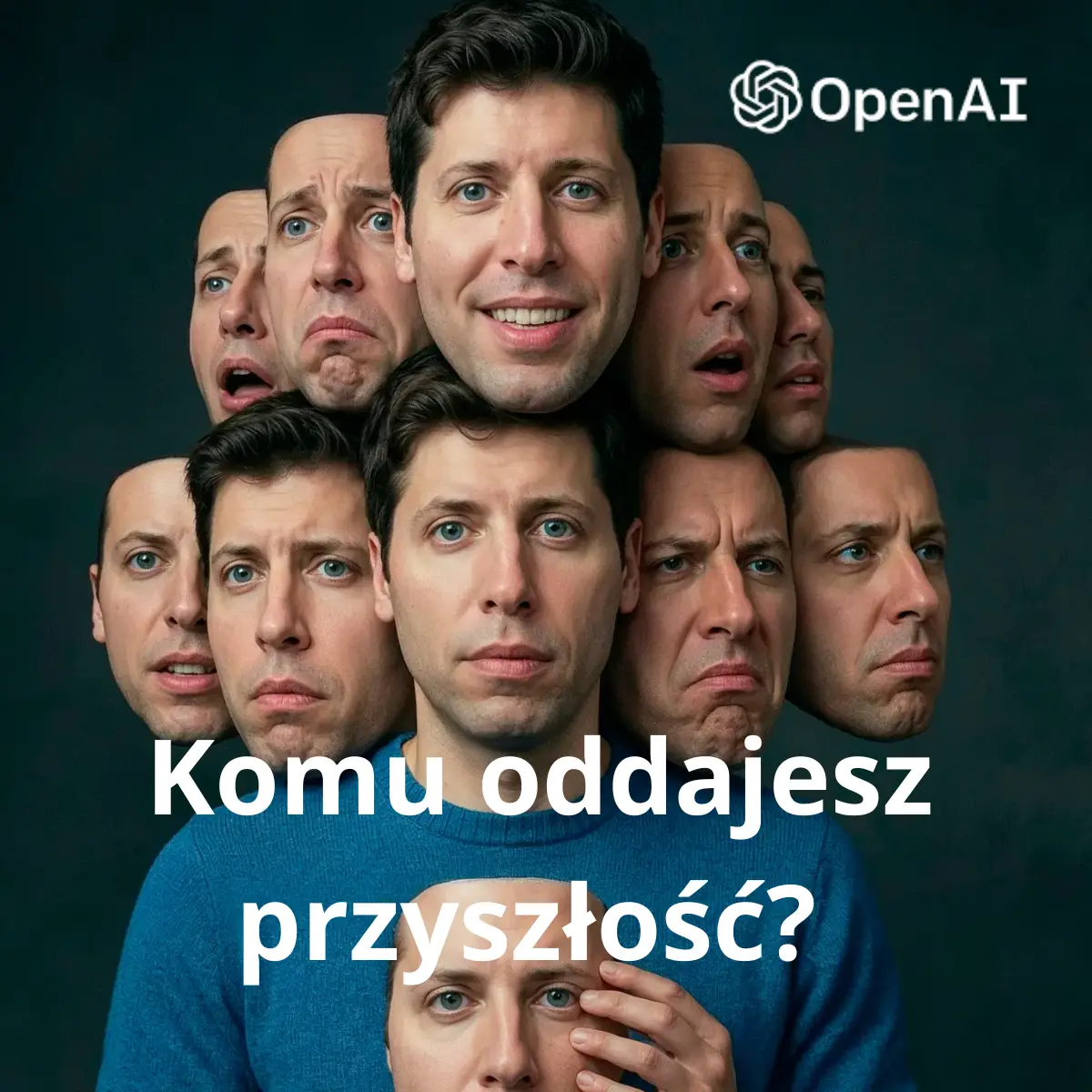

- Centralne pytanie: czy człowiek, który zbudował najbardziej wpływową firmę AI na świecie, jest na tyle godny zaufania, by powierzyć mu technologię o potencjalnie gigantycznych skutkach dla ludzkości.

Wizerunek Sama Altmana

- W artykule przewija się motyw „podwójnej natury”: Altman jest niezwykle charyzmatyczny, umie zdobywać ludzi, budować wrażenie troski i misji, ale wiele osób opisuje go jako człowieka gotowego naginać prawdę i manipulować dla osiągnięcia celu.

- Byli współpracownicy – od wczesnego startupu Loopt po Y Combinator i OpenAI – określają go jako osobę „kompulsywnie kłamiącą”, a nawet „socjopatyczną”, powtarza się zdanie „Samowi nie można ufać”.

- Jeden z byłych członków zarządu opisuje „dwie rzadko spotykane razem cechy: ogromną potrzebę przypodobania się rozmówcy i niemal socjopatyczny brak troski o konsekwencje okłamywania go”.

„Memy Ilyi” i notatki Amodeia

- Ilya Sutskewer (współzałożyciel i były Chief Scientist OpenAI) w 2023 r. rozesłał do wybranych ludzi z zarządu serię memów, zaczynając od nagłówka: „Sam wykazuje stały wzorzec …”, gdzie pierwszy punkt brzmiał „Kłamstwo”.

- W memach zarzuca Altmanowi m.in. wprowadzanie w błąd zarządu i menedżerów w kwestiach bezpieczeństwa, obiecywanych zasobów obliczeniowych oraz kluczowych decyzji produktowych.

- Dario Amodei (obecnie CEO Anthropic, wcześniej szef bezpieczeństwa w OpenAI) w swoich 200‑stronicowych notatkach podsumowuje: „Problemem OpenAI jest Sam”.

- Obaj – niezależnie – dochodzą do wniosku, że styl zarządzania Altmana nie tworzy środowiska sprzyjającego bezpiecznemu rozwojowi silnej AI.

Zasoby na bezpieczeństwo vs. marketing

- Publicznie Altman i OpenAI deklarowali, że nawet 20% mocy obliczeniowej firmy będzie przeznaczone na badania bezpieczeństwa i „superalignment”.

- W praktyce, według ludzi z zespołu, realnie było to około 1–2% i często na gorszym sprzęcie; zespół superalignment został ostatecznie rozwiązany, zanim osiągnął swoje cele.

- W artykule to zderzenie deklaracji z rzeczywistością powtarza się wielokrotnie: publiczne obietnice odpowiedzialności, a wewnątrz silny nacisk na tempo wdrożeń i komercjalizację (ChatGPT, umowy z Microsoftem, integracje biznesowe).

Kulisy zwolnienia Altmana w 2023 r.

- Artykuł wraca do kryzysu z listopada 2023 r., kiedy zarząd OpenAI nagle zwolnił Altmana, a po kilku dniach – pod presją pracowników, inwestorów i opinii publicznej – przywrócił go na stanowisko.

- Z dokumentów i relacji wynika, że powodem miała być właśnie utrata zaufania: zarząd czuł, że Altman manipuluje informacjami i omija struktury nadzoru.

- Przykład: miał zawrzeć „tajny pakt” z Gregiem Brockmanem i Ilyą Sutskewerem, w którym zobowiązał się oddać stanowisko, jeśli Brockman i Sutskewer uznają to za konieczne – o czym zarząd nie wiedział.

- Paul Graham i inni partnerzy Y Combinatora mieli wcześniej podobne obawy; Graham miał mówić, że „Sam kłamał nam cały czas”, co według artykułu pokazuje ciągłość wzorca zachowań.

Non‑profit, pieniądze i wejście w „military‑industrial complex”

- OpenAI startuje jako non‑profit z misją ochrony ludzkości przed niekontrolowaną AGI, ale bardzo szybko powstaje skomplikowana struktura for‑profit, z limitem zwrotu i preferencyjnym udziałem inwestorów.

- Już w 2017 r. wewnętrzne dokumenty mają pokazywać, że założyciele w praktyce nie wierzą w trwałość non‑profit; kiedy publicznie zapewniają, że „pozostają oddani modelowi non‑profit”, równolegle przygotowują konstrukcję B‑corp/for‑profit – w artykule pada stwierdzenie, że „w tym momencie to już było kłamstwo”.

- Autorzy opisują sieć powiązań finansowych: fundusze z Doliny Krzemowej, miliardy z Microsoftu, kapitał z autokratycznych państw Zatoki Perskiej, wycenę sięgającą biliona dolarów, a także negocjacje w sprawie wejścia na giełdę.

Wątki geopolityczne i militarne

- We wczesnych latach w OpenAI rozważano skrajny scenariusz: wystawienie dostępu do zaawansowanych modeli w „przetargu” między mocarstwami (wymieniane są m.in. Chiny i Rosja), by maksymalnie podbić wycenę – pomysł porzucono dopiero po groźbach odejścia części pracowników.

- W nowszym okresie kluczowe jest zaangażowanie OpenAI w projekty wojskowe – artykuł opisuje, że gdy Anthropic odmówił Pentagonowi zniesienia zakazu prac nad autonomiczną bronią, Altman publicznie wyraził solidarność, ale jednocześnie prywatnie negocjował miliardowy kontrakt dla OpenAI.

- Ostatecznie OpenAI miało podpisać umowę na integrację swoich modeli z systemami wojskowymi, co zdaniem autorów pokazuje, że etyczne deklaracje Altmana są często rozjechane z praktyką.

Obraz branży i wnioski autorów

- Farrow i Marantz podkreślają, że choć tekst koncentruje się na Altmanie, problem jest szerszy: cała branża frontier‑AI nagradza ludzi za agresywne ryzyko, szybkie skalowanie i „wizjonerskie” narracje, a nie za ostrożność.

- Podobne napięcia widać w innych firmach – Anthropic, Google DeepMind czy xAI – gdzie bezpieczeństwo ściera się z interesami inwestorów, kontraktami wojskowymi i presją konkurencji.

- Konkluzja artykułu jest raczej pesymistyczna: jeśli kluczowa technologia przyszłości jest w rękach osób, które wielokrotnie naginały prawdę i tworzyły „parawan misji”, to tradycyjne mechanizmy nadzoru (zarządy, regulacje, wewnętrzne komitety) mogą być zbyt słabe, by powstrzymać niebezpieczne decyzje.

Co to oznacza praktycznie

- Autorzy sugerują, że potrzebne są znacznie silniejsze, zewnętrzne mechanizmy kontroli nad firmami rozwijającymi AGI: regulacje, realne uprawnienia rad nadzorczych, przejrzystość finansowania i jasne rozdzielenie ról „misyjnych” od czysto komercyjnych.

- Jednocześnie pokazują, że Altman ma wyjątkową umiejętność przetrwania kryzysów: nawet gdy traci zaufanie części współpracowników, potrafi skonsolidować poparcie inwestorów, pracowników i opinii publicznej, a krytycy często odchodzą z firmy, zamiast ją realnie zreformować.

Jak wybrać odpowiedniego Interim Managera?

Jak wybrać odpowiedniego Interim Managera?  Sztuczna Inteligencja - potężne narzędzie czy zbędny hype?

Sztuczna Inteligencja - potężne narzędzie czy zbędny hype?